机器人领域是近年来取得了重大进展的领域,但我们与机器人同行之间的一个主要区别是我们的感觉能力。仅仅拥有执行任务的灵巧性并不总是足够的,因为我们的触觉会为大脑提供大量上下文信息。今天,新加坡国立大学 (NUS) 的研究人员展示了允许机器人感知触摸的新工具,这可能为他们执行更多任务打开了窗口。

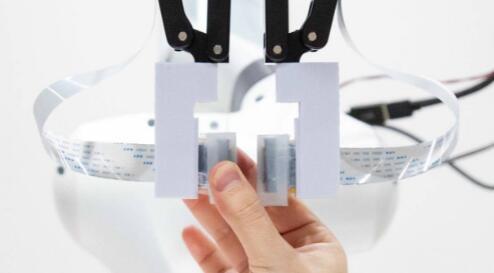

今天的公告已经酝酿了很长时间。去年,由 Benjamin Tee 助理教授领导的新加坡国立大学材料科学与工程团队详细介绍了一种人造皮肤传感器的开发,该传感器旨在为机器人和假肢提供触觉。正如 Tee 在今天的公告中所解释的那样,开发人造皮肤只是让团队实现了实际使用皮肤来增强机器人能力的目标。

“制造一个超快的人造皮肤传感器解决了让机器人更聪明的一半难题,”Tee 说。“他们还需要一个可以最终实现感知和学习的人工大脑,作为拼图的另一个关键部分。”

在这种情况下,大脑是英特尔的 Loihi 神经拟态计算芯片。Loihi 使用尖峰神经网络处理人造皮肤收集的触摸数据和基于事件的相机收集的视觉数据。在一项测试中,新加坡国立大学的研究人员让机械手“阅读”盲文字母,然后通过云将触觉信息传递给 Loihi。Loihi 能够以“超过 92% 的准确率”对这些字母进行分类,并且“比标准冯诺依曼处理器使用的功率低 20 倍”。

在另一项测试中,研究人员将触摸系统与基于事件的相机配对,让机器人对“装有不同量液体的各种不透明容器”进行分类。使用触觉和视觉数据,Loihi 能够识别每个容器的旋转滑动,新加坡国立大学的研究人员表示,这对于保持稳定的抓握非常重要。最后,研究人员发现,将基于事件的视觉与人造皮肤的触觉数据配对,然后用 Loihi 处理该信息“与仅视觉系统相比,对象分类的准确度提高了 10%。”

在日常生活中,既能感知又能感知的机器人可以有很多应用,无论是照顾老人或病人,还是在工厂处理新产品。赋予机器人感知能力也可以为自动化手术打开大门,这将是机器人技术向前迈出的一大步。

新加坡国立大学的研究结果发表在2020 年机器人科学与系统会议的一篇题为《机器人的事件驱动视觉触觉感知和学习》的论文中;您可以在上面嵌入的视频中观看有关提交给会议的这项研究的聚光灯讨论。

教育新闻网

教育新闻网